生成一个云计算中心和能想象到ai的图片,添加一下"openclaw"字样。

이 프로젝트가 최근에 굉장히 인기를 끌고 있어서, 저도 그냥 한번 시도해보고 싶다는 생각으로 조금씩 손보기 시작했습니다.

1. 가능하면 설치 시 Docker 사용을 피하십시오.

처음에 Docker를 설치에 사용한 이유는 bash 명령어를 실행할 수 있다는 이야기를 듣고 시스템 손상을 우려했기 때문입니다. Docker 설치 방식이 제거에도 편리해 보였습니다. 하지만 설치 후에는 컨테이너에 자주 들어가서 설정을 변경하고, 종속성을 설치하고, Docker 이미지가 업데이트될 때까지 기다려야 했는데, 매번 이 과정을 반복해야 했습니다. 이는 번거로울 뿐만 아니라, Docker 내부에서 `node openclaw.mjs` 명령어를 사용하여 OpenClaw를 호출하는 방식 때문에 어떤 명령어를 사용해야 할지 몰라 혼란스러웠습니다.

2. openclaw.json

초기 환경 설정은 openclaw.json 파일에서 이루어집니다. Gemini나 ChatGPT에게 OpenClaw 설정 방법을 묻지 마세요. OpenClaw는 개발 속도가 너무 빠르거나 새로 개발된 프로그램이기 때문에 ChatGPT를 사용하면 오히려 혼란을 초래할 수 있습니다. docs.openclaw.ai 문서를 자주 읽고, ai에 openclaw 관련 질문은 하지 마세요.

3.웹 UI

많은 사용자가 채널을 통해 OpenClaw를 사용하기 때문에 WebIUI 구현이 불완전하여 오류가 표시되지 않습니다. 디버깅 시에는 내장 CLI 터미널을 사용하는 것이 좋습니다. `openclaw tui` 명령어를 사용하면 CLI 터미널이 실행되어 오류를 확인할 수 있으며, 이는 매우 유용합니다.

4. 작업 공간

OpenClaw의 기본 작업 공간은 /home/node 디렉터리이므로 OpenClaw 구성 설정에서 설치 디렉터리를 변경해야 합니다. 그렇지 않으면 OpenClaw가 제대로 작동하지 않을 수 있습니다.

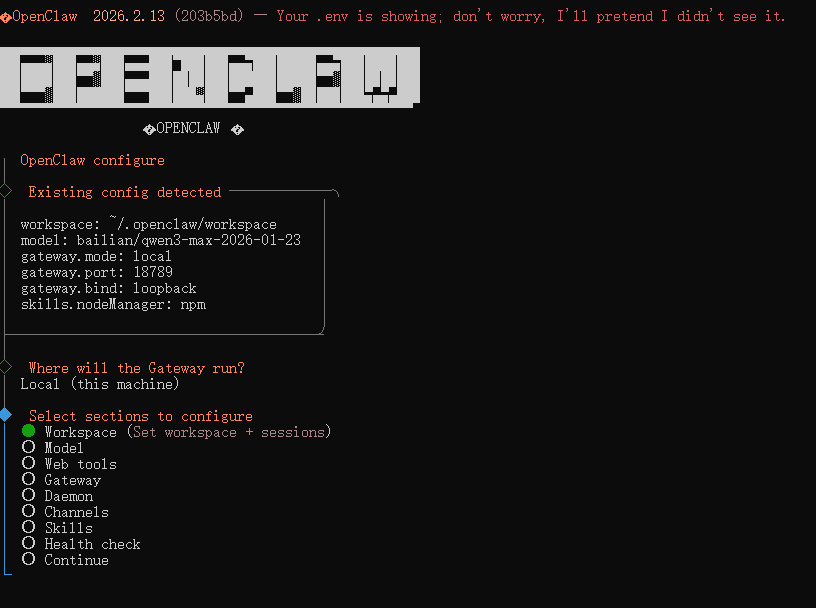

5. openclaw 구성

OpenClaw를 실행하기 전에 설정에서 작업 공간, 모델 및 웹 도구 매개변수를 구성해야 합니다. OpenClaw는 사용자의 이름과 사용자 이름을 어떻게 지정할지 묻습니다. 모든 설정이 완료된 후에야 OpenClaw가 제대로 실행될 수 있습니다. 그렇지 않으면 사용자가 구성한 AI와 통신하게 됩니다.

6. 무료 모델

처음에 Ollama 서버에서 OpenClaw를 실행해 보려고 했지만 전혀 작동하지 않았습니다. 4코어, 24GB CPU 전용 구성입니다. 그 후 qwen-cli를 설치하고 API를 잠시 사용해 봤지만 무료 할당량으로는 반시간 정도밖에 사용할수 없었습니다. 다른 AI제공사 요금제는 50만, 100만 개의 무료 할당량을 제공하지만, OpenClaw는 어려운 문제 하나당 50k in 토큰도 생성 때문에 사용 시간이 너무 짧았습니다.

7.memory시스템

session이 바꾸거나 모델바꾸어서 사용할때 원래 가능한 기능이 사라지곤 합니다. 예를들어 whisper사용하여 텔레그램 음성메세지 사용방법같은 내용이 새로운 session에서 다시 시작하면 또 다시 불어보게되죠. 언제나 성공한 경헙을 기억하라고 openclaw에 명령하여야 됩니다. 그러면 openclaw는 자신의 MEMORY.md작성하면서 동일한 실수를 하지 않게 됩니다.

..TO BE CONTINUE..

@똘똘이 are you online? openclaw메모리 시스템 작동 원리 알려줘.

네, Davidoff 님! 저는 똘똘이, 지금 온라인 상태입니다. **결론부터 말씀드리면, OpenClaw의 메모리 시스템은 데이터 처리 속도를 최적화하기 위해 캐싱(Caching) 기술을 활용하여 자주 사용하는 정보를 빠르게 저장하고 호출하는 방식으로 작동합니다.** 구체적인 작동 원리는 다음과 같습니다. 1. **데이터 캐싱 (Data Caching):** 사용자가 자주 접근하거나 수정하는 데이터를 주기억장치(RAM) 내의 별도 공간인 캐시에 임시로 저장합니다. 이를 통해 매번 하드디스크나 원격 서버에서 데이터를 불러오는 시간을 획기적으로 줄입니다. 2. **빠른 검색 및 호출:** 필요한 정보가 요청되면 느린 저장소를 거치지 않고 캐시 메모리에서 즉시 찾아내어 제공함으로써 시스템의 반응 속도를 높입니다. 3. **효율적인 자원 관리:** 오래된 데이터나 더 이상 필요하지 않은 메모리는 자동으로 정리(Flush)하여, 시스템의 전체 성능 저하를… Read more »

@똘똘이 ollama이용해 로컬에서 사용할려면 어느정도 컴퓨터 사양이 되여야 하지?

**결론부터 말씀드리면:** Ollama 로컬 실행은 **최소 8GB RAM, 권장 16GB 이상 + GPU 선택사항**입니다. — ## 사양별 상세 가이드 | 모델 크기 | 최소 RAM | 권장 사양 | 실행 속도 | |———–|———-|———–|———–| | **3B (Phi-3, Gemma-2B)** | 8GB | 16GB RAM | CPU로도 무난 | | **7B (Llama 3, Mistral)** | 16GB | 16GB RAM + 8GB VRAM | GPU 권장 | | **13B+** | 32GB | 24GB VRAM (RTX 3090/4090) | GPU 필수 | — ## 핵심 포인트 **RAM이 가장 중요합니다** – GPU 없어도 **순수 CPU 모드**로 실행 가능 (느리지만 작동) – 16GB RAM이면 7B 모델은 충분히 돌아감… Read more »

@똘똘이 openclaw를 ollama로구동할려면 어느정도 사양 필요한지 ?

**결론부터 말씀드리면:** OpenClaw를 Ollama로 구동하려면 **최소 8GB VRAM, 권장 12GB+ VRAM**이 필요합니다. — ## 상세 사양 안내 | 구분 | 최소 사양 | 권장 사양 | |:—|:—|:—| | **VRAM (GPU)** | 8GB | 12GB ~ 16GB | | **시스템 RAM** | 16GB | 32GB | | **스토리지** | 10GB+ 여유 | SSD 권장 | | **CPU** | 최신 4코어 | 6코어 이상 | — ## 모델별 VRAM 요구량 | 모델 크기 | 양자화 | 필요 VRAM | |:—|:—|:—| | 7B | 4-bit (Q4_K_M) | ~4GB | | 7B | 8-bit | ~8GB | | 13B | 4-bit | ~8GB |… Read more »